LONDON (AP) — AI lažiranje brzo postaje jedan od najvećih problema s kojima se suočavamo na internetu. Varljive slike, video i audio zapisi sve su veći kao rezultat porasta i zlouporaba alata generativne umjetne inteligencije.

S AI deepfakeovima koji se pojavljuju gotovo svaki dan, prikazujući sve iz Taylor Swift do Donald Trump, sve je teže razlikovati što je stvarno od onoga što nije. Generatori videa i slika poput DALL-E, Midjourney i Sora iz OpenAI-ja olakšajte ljudima bez ikakvih tehničkih vještina stvaranje deepfakeova — samo upišite zahtjev i sustav će ga izbaciti.

Ove lažne slike mogu se činiti bezopasnima. Ali mogu se koristiti za izvođenje prijevara i krađu identiteta ili propagandu i izbornu manipulaciju.

Evo kako izbjeći da vas deepfakeovi prevare:

KAKO PREPOZNATI DEEPFAKE

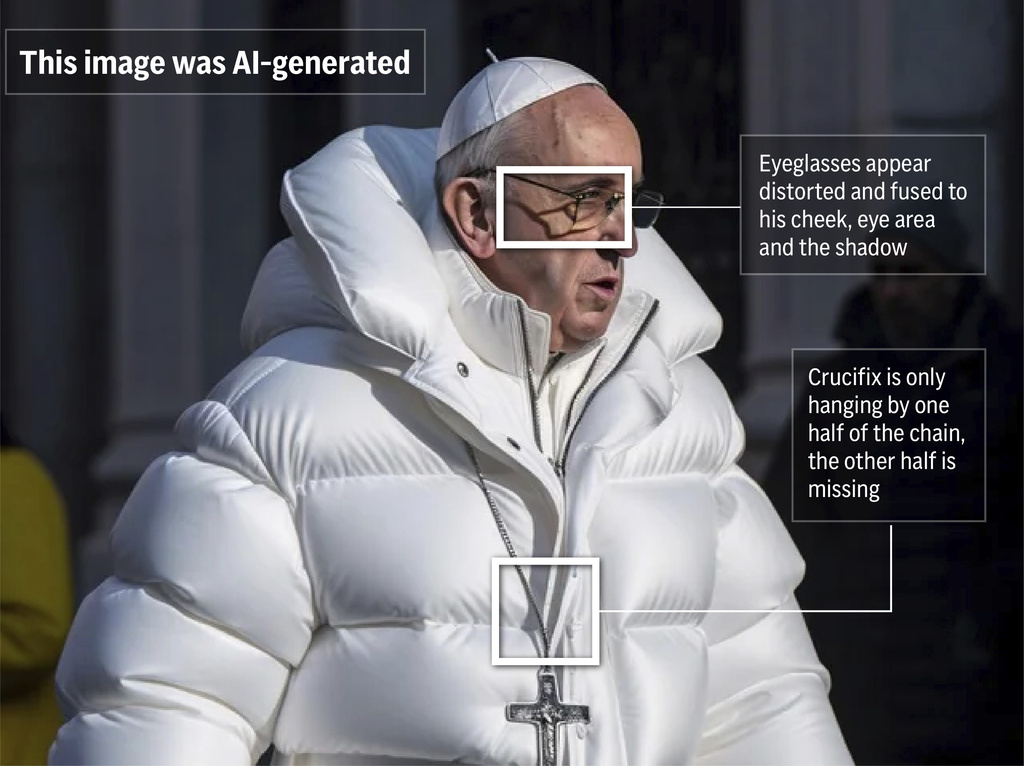

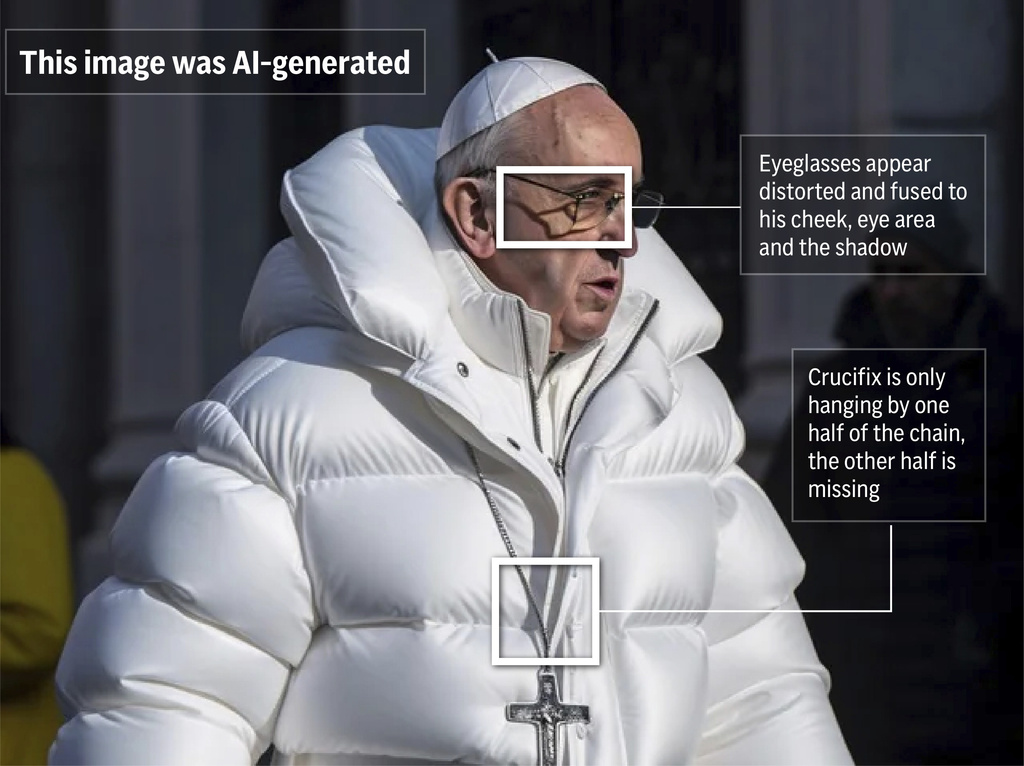

U ranim danima deepfakeova, tehnologija je bila daleko od savršene i često je ostavljala izdajničke znakove manipulacije. Oni koji provjeravaju činjenice ukazali su na slike s očiglednim pogreškama, poput ruku sa šest prstiju ili naočala koje imaju različito oblikovane leće.

Ali kako se AI poboljšavao, postalo je puno teže. Neki naširoko dijeljeni savjeti – poput traženja neprirodnih obrazaca treptanja među ljudima u deepfake video zapisima – više ne vrijede, rekao je Henry Ajder, osnivač konzultantske tvrtke Latent Space Advisory i vodeći stručnjak za generativnu umjetnu inteligenciju.

Ipak, postoje neke stvari koje treba tražiti, rekao je.

Puno AI deepfake fotografijeposebno kod ljudi, imaju elektronički sjaj, “estetsku vrstu zaglađujućeg učinka” koji ostavlja kožu “nevjerojatno ulaštenom”, rekao je Ajder.

Upozorio je, međutim, da kreativno poticanje ponekad može eliminirati ovaj i mnoge druge znakove manipulacije umjetnom inteligencijom.

Provjerite dosljednost sjena i osvjetljenja. Često je subjekt u jasnom fokusu i djeluje uvjerljivo realno, ali elementi u pozadini možda nisu tako realistični ili uglađeni.

POGLEDAJTE LICA

Zamjena lica jedna je od najčešćih metoda deepfakea. Stručnjaci savjetuju pažljivo promatranje rubova lica. Odgovara li ton kože lica ostatku glave ili tijela? Jesu li rubovi lica oštri ili mutni?

Ako sumnjate da je video osobe koja govori lažirana, pogledajte njezina usta. Poklapaju li se njihovi pokreti usana sa zvukom savršeno?

Ajder predlaže gledanje u zube. Jesu li jasni ili su mutni i na neki način nisu u skladu s onim kako izgledaju u stvarnom životu?

Tvrtka za kibernetičku sigurnost Norton kaže da algoritmi možda još nisu dovoljno sofisticirani da generiraju pojedinačne zube, pa bi nedostatak obrisa za pojedinačne zube mogao biti trag.

RAZMIŠLJAJTE O ŠIROJ SLICI

Ponekad je kontekst bitan. Malo razmislite je li ono što vidite vjerojatno.

Web stranica Poynter novinarstva savjetuje da ako vidite javnu osobu da radi nešto što se čini “pretjerano, nerealno ili nije u karakteru”, to bi mogao biti deepfake.

Na primjer, bi li papa doista nosio luksuznu pufer jaknu, kao prikazano notornom lažnom fotografijom? Da jest, ne bi li legitimni izvori objavili dodatne fotografije ili videozapise?

KORIŠTENJE AI ZA PRONALAŽENJE LAŽNJAKA

Drugi pristup je korištenje umjetne inteligencije u borbi protiv umjetne inteligencije.

Microsoft je razvio alat za provjeru autentičnosti koji može analizirati fotografije ili videozapise kako bi dao ocjenu pouzdanosti o tome jesu li manipulirani. Proizvođač čipova Intel FakeCatcher koristi algoritme za analizu piksela slike kako bi utvrdio je li prava ili lažna.

Postoje online alati koji obećavaju da će nanjušiti krivotvorine ako učitate datoteku ili zalijepite vezu na sumnjivi materijal. No neki, poput Microsoftovog autentifikatora, dostupni su samo odabranim partnerima, a ne javnosti. To je zato što istraživači ne žele dojaviti lošim akterima i dati im veću prednost u duboko lažnoj utrci u naoružanju.

Otvoreni pristup alatima za otkrivanje također bi mogao ljudima dati dojam da su “božanstvene tehnologije koje mogu eksternalizirati kritičko razmišljanje umjesto nas” kada umjesto toga moramo biti svjesni njihovih ograničenja, rekao je Ajder.

PREPREKE PRONALAŽENJA LAŽNJAKA

Uz sve ovo rečeno, umjetna inteligencija napreduje vrtoglavom brzinom, a modeli umjetne inteligencije obučavaju se na internetskim podacima kako bi proizvodili sve kvalitetniji sadržaj s manje nedostataka.

To znači da nema jamstva da će ovaj savjet vrijediti čak i za godinu dana.

Stručnjaci kažu da bi čak moglo biti opasno staviti teret na obične ljude da postanu digitalni Sherlocks jer bi im to moglo dati lažan osjećaj samopouzdanja jer postaje sve teže, čak i za uvježbane oči, uočiti deepfakeove.